- Blog

- Reconhecimento facial: O que pode dar errado?

Reconhecimento facial: O que pode dar errado?

A tecnologia de reconhecimento facial está sendo questionada globalmente, principalmente em relação a segurança, privacidade e quanto está livre de viéses e preconceitos

Assine nosso blog

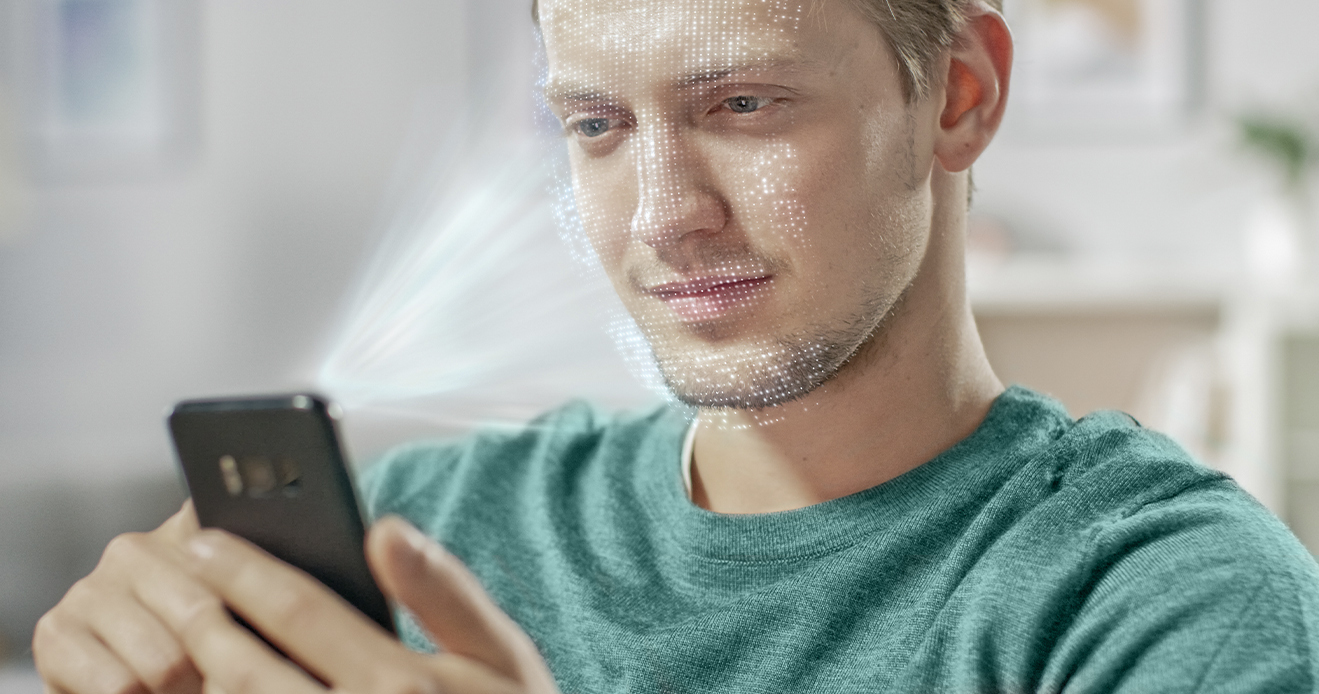

A tecnologia de reconhecimento facial já existe há alguns anos. Já é comumente usada para desbloquear telefones, abrir novas contas em bancos digitais e até mesmo para comprovar a identidade de pessoas na alfândega em aeroportos. Embora seja um bom recurso para sistemas que precisam de comprovação de identidades, está começando a lidar com questões de segurança, viés e privacidade do usuário.

Toda tecnologia pode ter aplicações boas e ruins. Algumas aplicações de reconhecimento facial são mais seguras do ponto de vista da privacidade, como a identificação facial no iPhone, porque os dados são processados localmente. As coisas se tornam perigosas quando começam a ser utilizadas para a aplicação da lei e quando a implantação acontece em locais públicos, por exemplo.

Mais recentemente, um projeto para usar o reconhecimento facial para identificar criminosos na Companhia Metropolitana de Metrô de São Paulo acaba de ser negado por várias agências de proteção ao consumidor, incluindo a Idec. A iniciativa visava usar câmeras de alta definição em estações de metrô em toda a capital para identificar infratores, através da integração da tecnologia de reconhecimento facial com o banco de dados da polícia. A principal razão para a negação da aprovação foi a falta de garantia de segurança na captura de dados dos usuários do metrô, especialmente crianças e adolescentes, que possuem proteção constitucional especial.

O projeto impactaria um total de 3,7 milhões de passageiros diariamente e a falta de segurança poderia acarretar problemas em uma possível violação de dados, incluindo a venda de dados de usuários, acesso aos hábitos e horários dos usuários, bem como o roubo dessas informações por criminosos. Isto aponta para um dos primeiros problemas com esta tecnologia, no que diz respeito à segurança: O rosto de uma pessoa são dados estáticos, o que significa que eles nunca podem ser alterados. Uma vez que esses dados estejam na posse de infratores, o proprietário desses dados nunca mais estará 100% seguro para usar isso como comprovante de identidade novamente.

Outro ponto de atenção são os erros na identificação das pessoas, que podem causar constrangimento e até mesmo injustiça. Robert Williams, um residente da cidade de Detroit, nos Estados Unidos, foi preso injustamente pela polícia da cidade. Eles adotaram recentemente um software de reconhecimento facial em suas operações, o que identificou erroneamente Williams como um criminoso. O chefe da polícia de Detroit disse que a tecnologia não só não é confiável, mas não consegue identificar completamente as pessoas 95% do tempo. Isto nos leva à segunda fragilidade do reconhecimento facial: pode ser potencialmente enviesada por raça, idade e sexo, dependendo dos conjuntos de dados usados para treinar a IA, por exemplo.

Por último, mas não menos importante, é um desafio fazer uma implantação da tecnologia de reconhecimento facial em espaços públicos, uma vez que esta coleta de dados não deveria ser um pré-requisito para usar um serviço essencial como o metrô.Os usuários precisam ser capazes de controlar os dados que são coletados sobre eles e, idealmente, só seriam coletados após o consentimento explícito do usuário.

Recentemente, com os protestos do movimento Black Lives Matter globalmente, várias empresas deram um passo atrás na adoção da tecnologia. O CEO da IBM Arvind Krishna, por exemplo, emitiu uma declaração oficial dizendo que não ofereceriam, desenvolveriam ou pesquisariam tecnologias de identificação facial, pois ele é contra a vigilância em massa, o estabelecimento de perfis raciais e as violações dos direitos e liberdades básicas de todas as pessoas. Enquanto isso, a Amazon, que anunciou que proibiria a polícia de usar seu programa de reconhecimento facial por um ano, está pressionando para que padrões rigorosos sejam criados para que a tecnologia possa ser usada eticamente no futuro. Finalmente, a Microsoft também decidiu limitar o uso de sua ferramenta de reconhecimento facial pelos departamentos policiais até que uma lei seja criada para regulamentar seu uso.

Com a crescente conscientização das questões de privacidade, viéses e preconceitos, novas tecnologias estão sendo cada vez mais avaliadas para determinar se protegem a privacidade do usuário e são livres de preconceitos. O reconhecimento facial está atualmente sob este escrutínio, e todas as tecnologias devem esperar ser submetidas a este processo.

Na Incognia, a privacidade é o cerne de nossa empresa, na verdade, nosso principal valor empresarial é respeitar e colocar a privacidade do usuário em primeiro lugar. Criamos uma identidade digital privada que se baseia puramente no histórico de comportamento único de cada usuário em termos de localização. Cuidamos para que todos os dados sejam criptografados, hasheados e agrupados, o que protege o anonimato dos usuários. Isto elimina a possibilidade de vincular identidade e localização no mundo real, tornando-a inerentemente livre de preconceitos, viéses e privada.

Saiba mais sobre Incognia, a solução de biometria comportamental baseada em localização.